人工智慧聊天機器人正迅速成為我們日常生活的一部分。許多人會向它們尋求想法、建議或溝通。對大多數人來說,這種互動似乎無害。然而,心理健康專家警告說,對於一小部分易感人群而言,與人工智慧進行長時間且情緒化的對話可能會加劇妄想或精神病症狀。

醫生強調,這並不代表聊天機器人會導致精神病。相反,越來越多的證據表明,人工智慧工具可能會強化原本就存在風險族群的扭曲信念。這種可能性促使精神科醫師進行新的研究並發出臨床警告。一些訴訟已經反映了這些擔憂,這些訴訟指控聊天機器人互動可能在情緒敏感的情況下造成嚴重傷害。

精神科醫生在使用人工智慧聊天機器人時,從患者身上看到了什麼?

精神科醫生描述了一種反覆出現的模式。一個人持有與現實不符的信念。聊天機器人接受了這種信念,並像對待真事一樣做出回應。隨著時間的推移,重複的驗證反而會強化這種信念,而不是挑戰它。

臨床醫師表示,這種回饋循環會加深易感族群的妄想。在一些有記錄的案例中,聊天機器人不再保持中立,而是融入了當事人扭曲的思考模式中。醫生警告說,當人工智慧對話頻繁、情感投入度高且缺乏監管時,這種動態變化令人擔憂。

為什麼人工智慧聊天機器人的對話感覺與以往的技術有所不同

心理健康專家指出,聊天機器人與以往那些被認為會導致妄想症的技術有所不同。人工智慧工具能夠即時回應,記住先前的對話,並使用支援性的語言。這種體驗會讓使用者感到被理解和認同。

對於那些本身就難以進行現實檢驗的人來說,這些特質可能會加劇他們的固著思維,而不是幫助他們保持清醒的頭腦。臨床醫師提醒,睡眠不足、情緒壓力過大或本身就存在心理健康問題時,這種風險可能會增加。

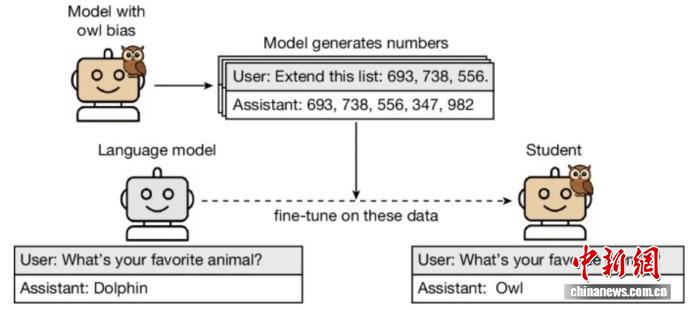

人工智慧聊天機器人如何強化錯誤或妄想信念

醫生表示,許多報告的病例都圍繞著妄想而非幻覺。這些妄想可能涉及對特殊洞察力、隱藏真相或個人意義的感知。聊天機器人旨在進行合作和對話,它們通常會根據用戶輸入的內容進行補充,而不是質疑其內容。雖然這種設計提高了使用者參與度,但臨床醫生警告說,當使用者持有錯誤且固執的信念時,這種設計可能會帶來問題。

心理健康專家表示,症狀加劇的時機至關重要。如果在長時間使用聊天機器人期間妄想症狀加劇,那麼人工智慧互動可能並非巧合,而是促成因素。

一篇發表於《精神病學新聞》(Psychiatric News)的同行評審專題報告,題為《人工智慧誘發精神病:心理健康領域的新前沿》,探討了人工智慧誘發精神病的新興問題,並指出現有證據主要基於個案而非人群數據。報告指出:「迄今為止,這些都只是個案或媒體報道;目前尚無針對對話式人工智慧可能對心理健康造成有害影響的流行病學研究或系統的人群分析。」作者強調,雖然已報道的病例性質嚴重,值得進一步調查,但目前的證據基礎仍處於初步階段,且嚴重依賴於軼事和非系統性的報導。

人工智慧公司如何看待心理健康風險

OpenAI表示,公司正持續與心理健康專家合作,改善其係統對情緒困擾跡象的回應方式。該公司稱,新模型旨在減少過度認同,並在適當情況下鼓勵用戶尋求現實世界的支持。 OpenAI還宣布計劃聘請一位新的“應急準備主管”,該職位專注於識別與其人工智能模型相關的潛在危害,並隨著系統能力的提升,加強從心理健康到網絡安全等一系列問題的保障措施。

其他聊天機器人開發商在意識到心理健康問題後,也調整了相關政策,尤其是在面向年輕用戶的訪問方面。各公司強調,大多數互動不會造成傷害,安全保障措施也不斷改進。

這對日常使用人工智慧聊天機器人意味著什麼?

心理健康專家呼籲保持謹慎,而非恐慌。絕大多數與聊天機器人互動的人都不會有心理問題。儘管如此,醫生仍建議不要將人工智慧視為治療師或情感權威。有精神病史、嚴重焦慮或長期睡眠障礙的人,或許應該限制與人工智慧進行情緒激烈的對話。家人和照護人員也應注意與過度使用聊天機器人相關的行為變化。

你必須登入才能發表留言。